再创佳绩!辉羲智能与上海交大合作论文获 DAC 最佳论文提名

发表时间: 2023-07-24 22:00:00

近日,第60届电子设计自动化领域顶会 DAC 在美国旧金山成功举办。辉羲智能与上海交通大学合作发表的技术论文COSA: Co-Operative Systolic Arrays for Multi-head Attention Mechanism in Neural Network using Hybrid Data Reuse and Fusion Methodologies 荣获最佳论文提名奖,系中国内地唯一入选论文。

DAC(Design Automation Conference,CCF-A类)一直被公认是设计自动化领域的顶级会议,以专业、权威和高含金量著称,在国际半导体界享有重要地位和广泛影响。会议今年共接收论文1156篇,创下历史新高,录用率约为23%,最终仅有5篇入选最佳论文提名。

辉羲智能 | DAC 2023 论文分享

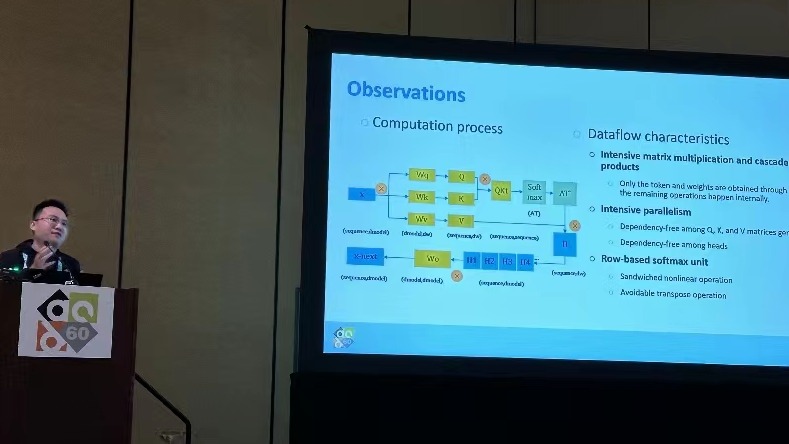

COSA: 探索Transformer固有计算特征,利用混合数据复用和多种融合技术,设计高能效高利用率低延迟的加速器

近年来,Transformer神经网络在计算机视觉、自然语言处理方面,表现出超过传统CNN、RNN神经网络的优越性能,特别如基于Transformer的大语言模型ChatGPT、在自动驾驶领域发挥优势的BEVformer,极大改变着人类的生产生活方式。但也因其巨大的参数量和计算量,硬件平台面临新一轮挑战。

许多学者从软硬件协同的角度出发,试图通过剪枝、模型压缩等方法稀疏化网络,并设计相应的硬件加速器。此方式的弊端在于精度的损失,通常需要繁琐的调参和重训练过程才有可能(但不保证)接近之前的精度水平。

辉羲智能和上海交大研究团队另辟蹊径,充分挖掘Transformer算子注意力机制的数据流特征,设计出业内首款基于数据流特征的Transformer加速器——COSA,成为该领域最早的研究之一。

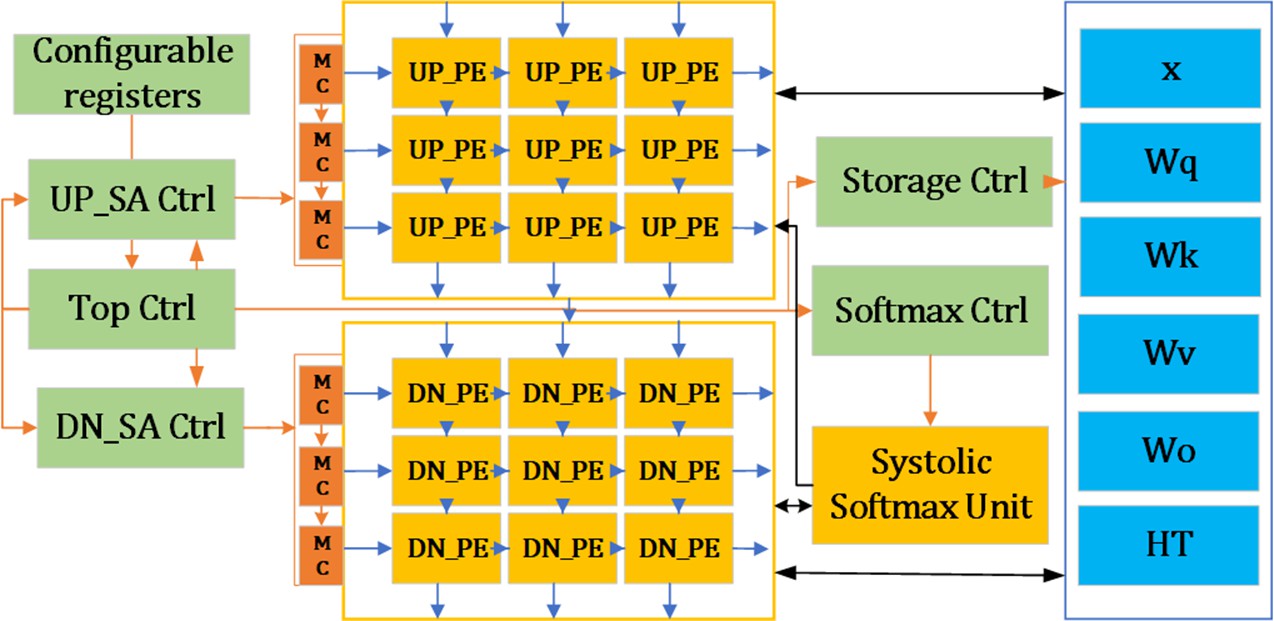

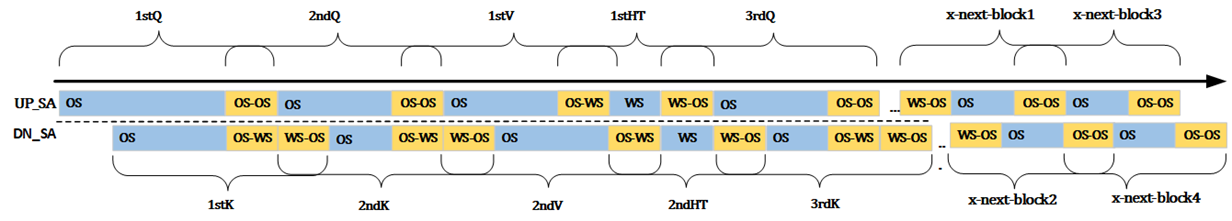

COSA设计了首个可运行时动态配置、支持混合数据复用的脉动阵列结构,其深度融合技术,有望系统性解决脉动阵列固有的建立排空时间长、PE利用率低问题;其他的各种融合技术,也是大幅减少访存、降低延迟的核心技术;此外设计了一个先进的softmax单元,具备高吞吐率,可以完全隐藏原来非线性计算的长延迟。相较于以往的设计,COSA实现了2.95-28.82倍的加速,以及1.61-21.6倍的能效提升。

今年 DAC 特地为Transformer设立了 Not fast enough? Hardware acceleration for transformers and beyond 专场,吸引了近百位工业界和学术界人士踊跃参与。辉羲和上海交大研究团队发表主题演讲,获得与会专家学者的高度认可,并在现场引起热烈讨论,足足让Q&A环节延长了半小时之久。

辉羲智能联合创始人、上海交通大学贺光辉教授表示:“高效的Transformer推理芯片架构,是BEV和GPT大规模商业化的算力基础。COSA的协同脉动阵列结构,提供更高的并行计算能力,充分利用数据复用机会,进而大幅减少访存、降低延迟、提升PE单元利用率,是我们「数据闭环定义芯片」在前沿产业应用与架构领域的碰撞结晶。高效算力带来普惠智能,创新闭环将会加速这个过程。”

面向未来,智能驾驶的新挑战和新课题需要产学研各界集聚智慧、合作共创。辉羲注重技术创新并契合市场需求,坚持用创新计算平台服务智慧出行,同时以开放共创的态度,携手客户和合作伙伴构建高阶智能驾驶系统的软硬件生态,推动产业智慧升级。